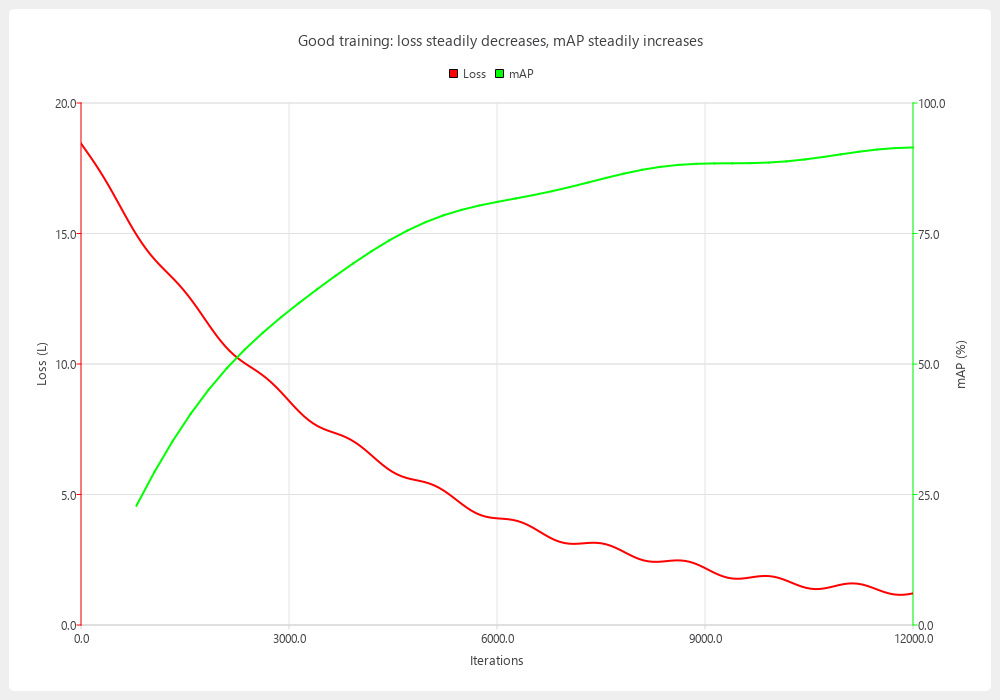

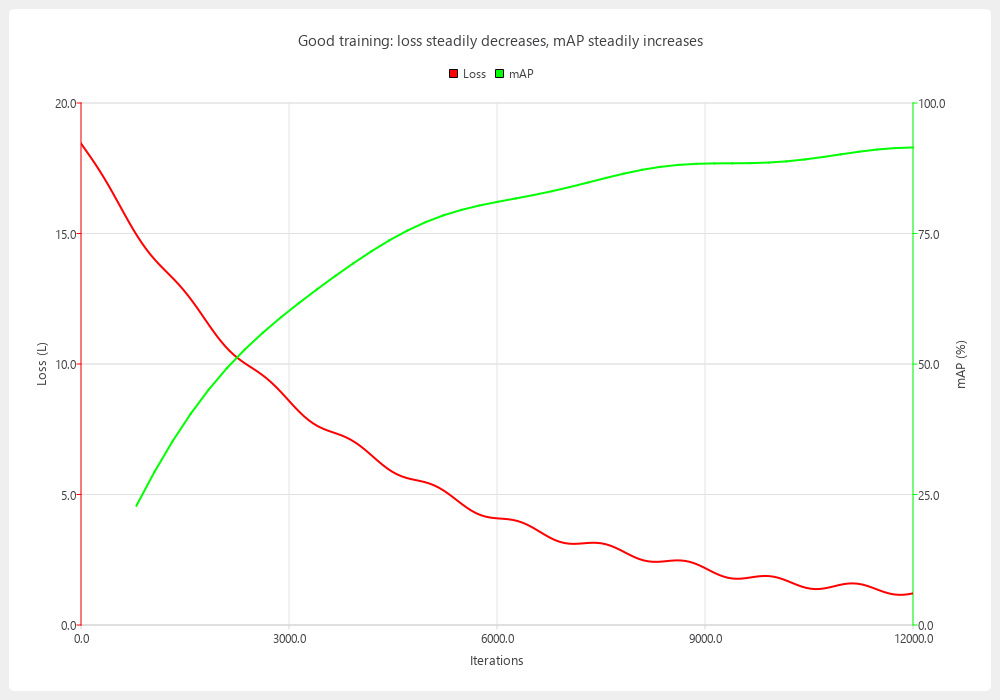

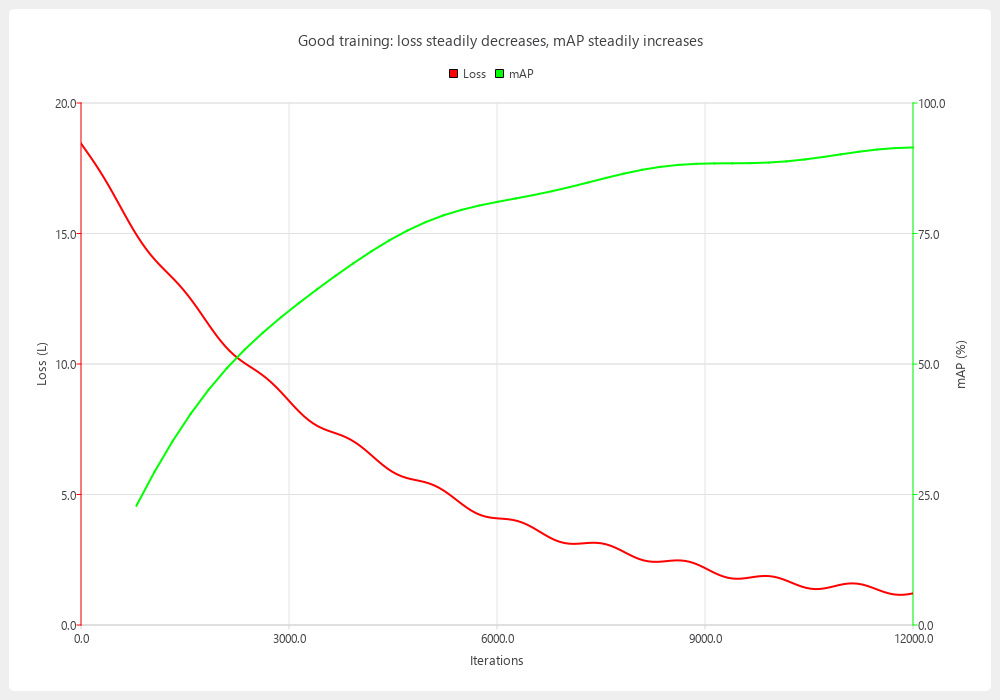

Ejemplo: buen entrenamiento (loss disminuye, mAP aumenta y luego se estabiliza)

Ejemplo: buen entrenamiento (loss disminuye, mAP aumenta y luego se estabiliza)

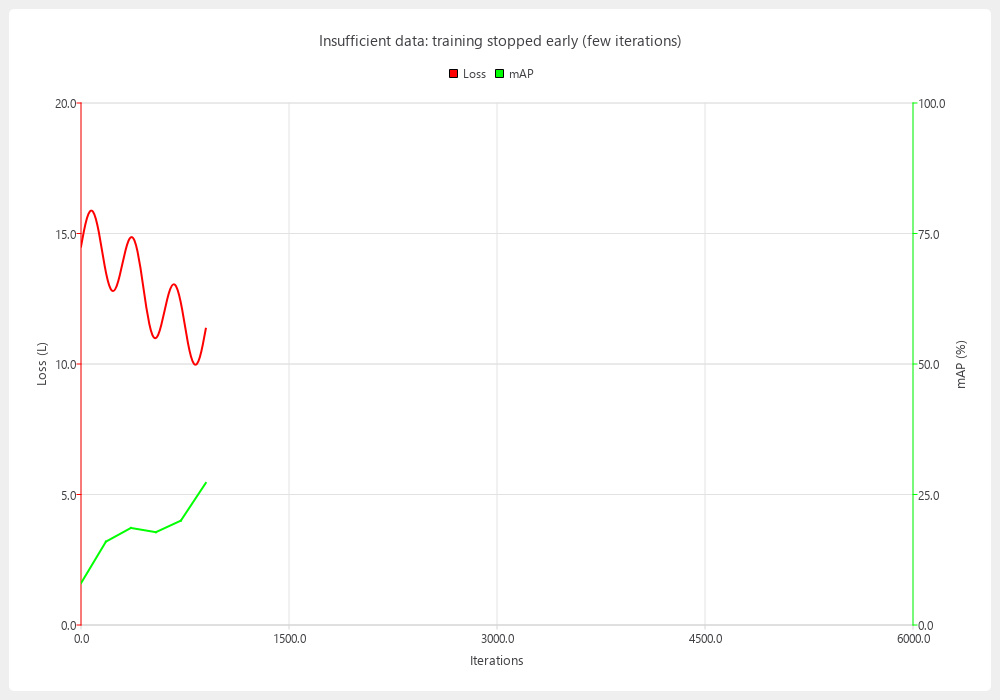

Datos insuficientes: muy pocos puntos / ejecución demasiado corta (métricas ruidosas al inicio)

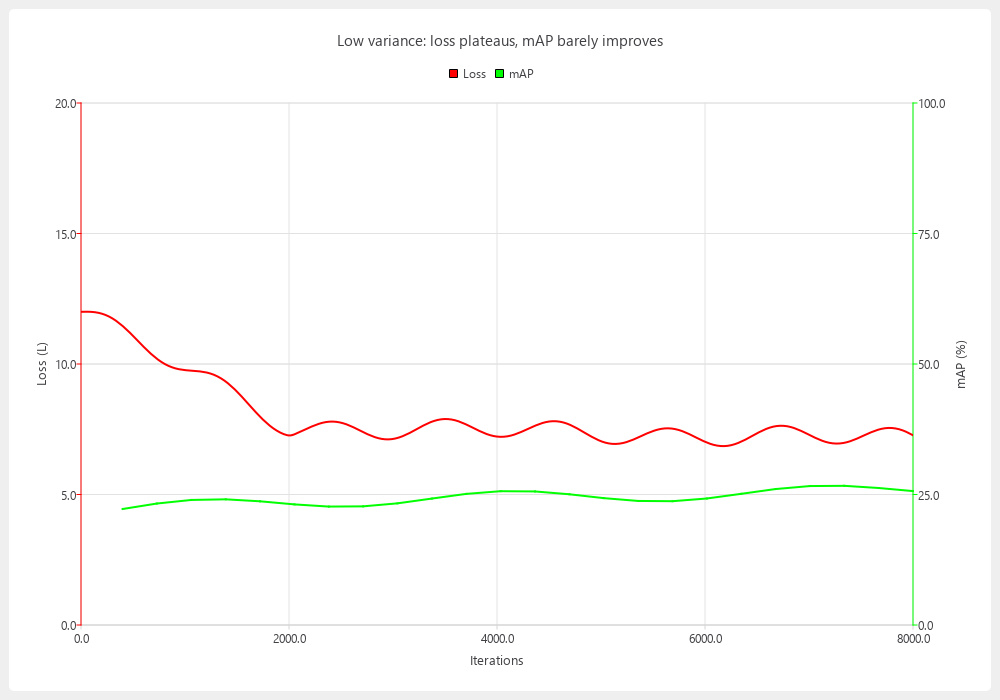

Baja varianza: el loss se estabiliza y el mAP apenas mejora

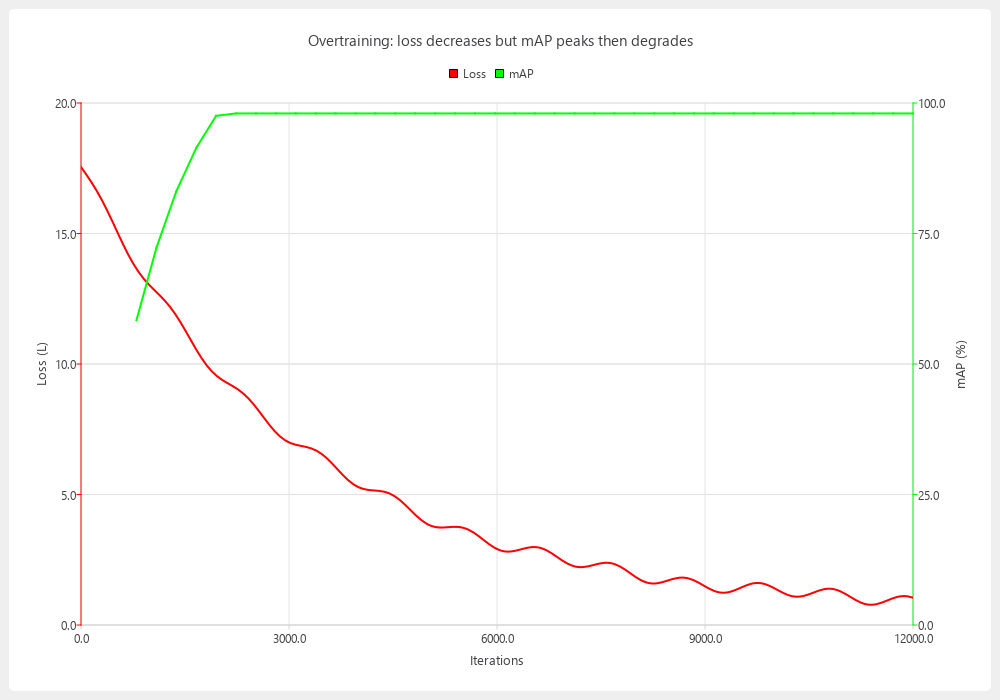

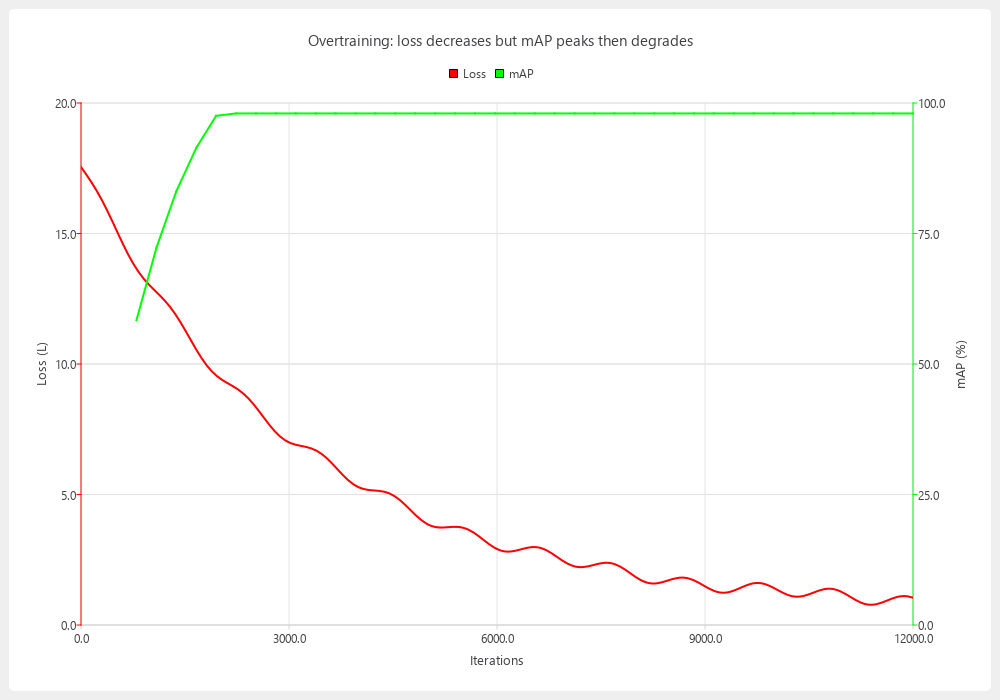

Sobreentrenamiento: el loss sigue mejorando, pero el mAP alcanza un pico (incluso muy alto) y luego empeora

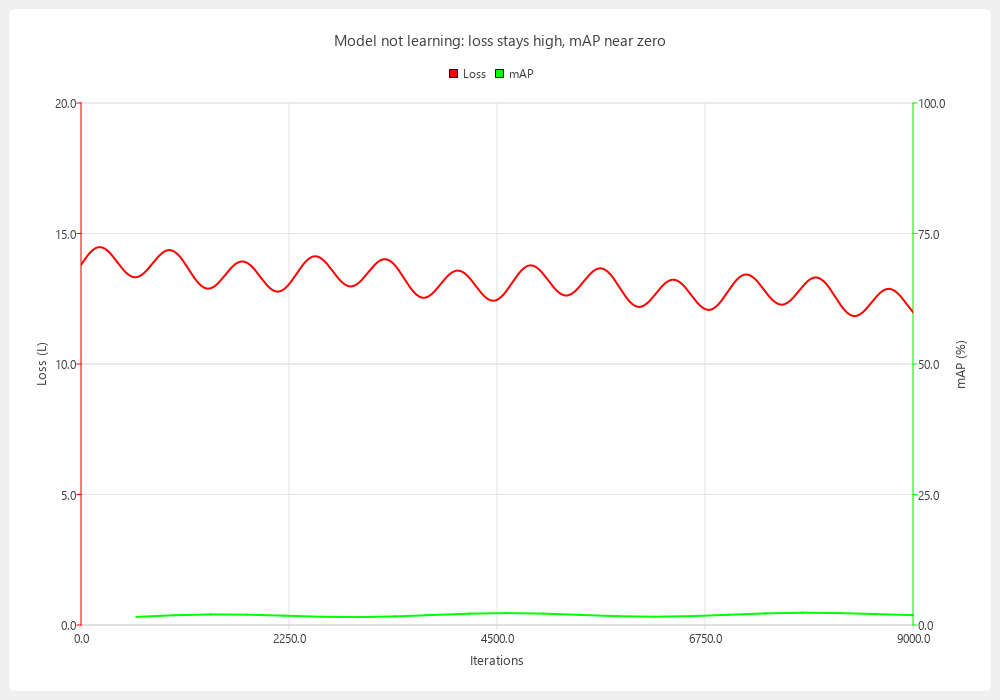

Modelo que no aprende: loss se mantiene alto/estable, mAP cercano a cero

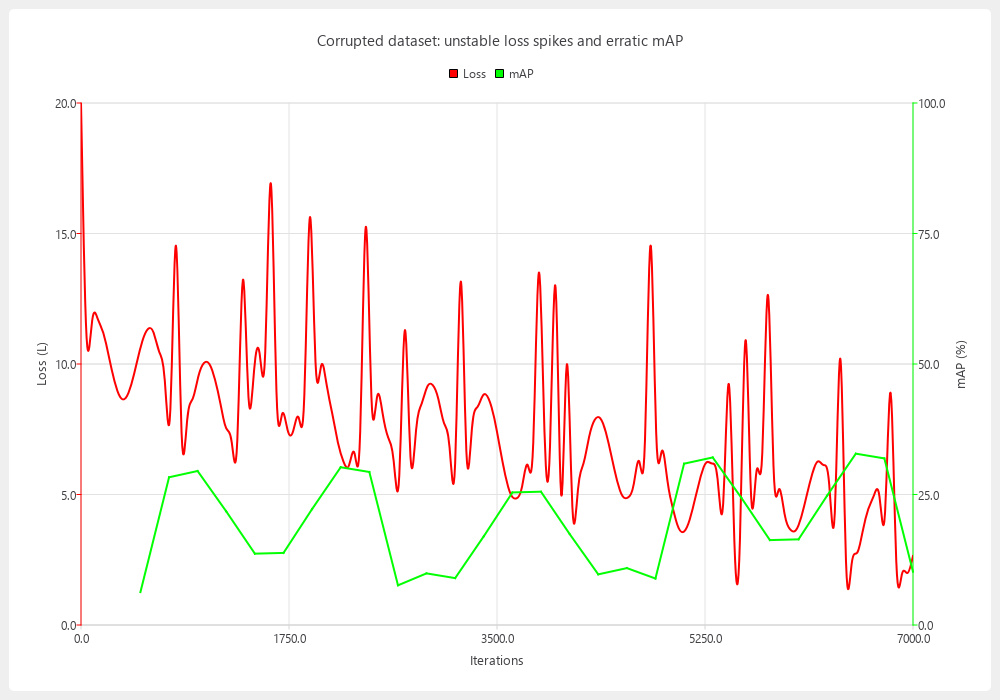

Conjunto de datos corrupto: picos inestables de loss y mAP errático

Buen entrenamiento: aprendizaje constante y una meseta alta y estable

.png?alt=media)

.png?alt=media)

Ejemplo de sobreentrenamiento: mAP alcanza un pico y luego cae mientras el loss sigue disminuyendo